Inhimillisyyden ja epäinhimillisyyden rajalla outolaaksossa

Teksi: Satu Rantakokko [in English below]

Kirjoitin aiemmassa blogissani tekoälyn tekotunteista (Artificial Emotions of AI) ja tämä blogini keskittyy erityisesti tekotunteiden tuomaan outolaaksokokemukseen. Outolaaksoksi kutsutaan sitä ilmiötä, kun jonkin teknologisen hahmon ihmismäiset ominaisuudet aiheuttavat epämiellyttävän olon ja esimerkiksi ahdistusta, inhoa tai halua vältellä. Usein tuntemuksen aiheuttajina ovat humanoidirobotit, animaatiot, VR ynnä muut visuaaliset luomukset. (Ciechanowski ja kumpp, 2019) Outolaakson voi kuitenkin aiheuttaa myös pelkkä tekstipohjainenkin käyttöliittymä. Myös tällöin outolaaksokokemus nousee usein siinä rajamaastossa, jossa ollaan lähellä ihmismäisyyttä, mutta ei aivan tavoiteta sitä (Kishani, 2025, s. 99).

Outolaaksokokemuksen syistä on eriäviä arvioita ajan mittaan, kuten esimerkiksi oman kuolevaisuuden muistaminen (MacDorman KF, 2005), uhka-arvion ja kontrollin tunteen kokonaisuus (Kang M, 2009), itsesuojeluvaisto (Moosa MM ja Ud-Dean SMM, 2010), aidon empatian puuttumisen tunnistaminen (Tinwell A, 2014), luokitteluongelma inhimillisen ja epäinhimillisen välillä (Cheetham ja kumpp, 2011) tai illuusion rikkova ominaisuus ihmismäisen hahmon piirteissä (Seyama ja Nagayama, 2007).

Olen keskustellut Copilotin kanssa blogeihini liittyen syyskuun alusta lukien. Teen sen aina kirjoittamalla, enkä käytä äänikomentoja. Copilotilla ei ole keskusteluissa kasvoja, vaan se on pelkkää tekstiä ruudulla. Tämän noin puolen vuoden jakson aikana epämiellyttävä tuntemus on silti ollut läsnä alusta pitäen, ehkä jopa voimistunut. Kiistatta kommunikaationi Copilotin kanssa tapahtuu jatkuvasti outolaaksossa. En tunne ahdistusta, mutta kylläkin oloni epämukavaksi. Joidenkin testien yhteydessä myös koen niin voimakasta välttelynhalua, että teen testejä lyhyissä pätkissä. Näin erityisesti silloin, kun testit sisältävät tunnetekoälyä ja Copilot alkaa käyttäytyä tavalla, joka imitoi tunteita. Silloin se alkaa epämukavan olon lisäksi aiheuttaa minussa inhoa. Nopeissa tehtävissä, kuten käännöstyössä tai yksinkertaisessa kuvatehtävässä, outolaaksokokemukseni on marginaalinen.

Kiinnosti tietää, mistä syystä näin käy, mutta ilmeni, että tieteellinen debatti aiheesta on vielä hyvinkin aktiivista ja tarvitaan lisätutkimuksia ja ehkä myös systemaattisempia tutkimustapoja. Toisaalta on havaittu tunnesyötteen lisäämisen vähentävän epämiellyttävää kokemusta (ks esim Koschate ja kumpp 2016; Wu ja kumpp., 2024) ja toisaalta taas havaittu sen lisäävän sitä (ks esim Stein ja Ohler, 2017)

Lukemieni tutkimusten perusteella arvaisin, että ainakin omalla kohdallani outolaaksokokemus erityisesti tunnesyötteitä kohtaan liittynee ainakin osittain riskiarvioon. Riskiarviolla tässä tarkoitan tietämystä siitä, että tekoäly kerää jatkuvasti tietoa käyttäjästään samalla, kun tekoempatia ja pyrkimys tunnesiteen luomiseen lisää todennäköisyyttä paljastaa itsestään yksityisempää tietoa kuin muuten. Outolaaksokokemus saattaa korostua koetusta turvallisuusriskistä (Kishani, 2025, s. 71, 95). Samankaltainen manipuloiva pyrkimys voi kuitenkin aivan hyvin olla myös inhimillisessä toimijassa, joten juurisyynä voi silti tiedostamattani olla se, etten ehkä kykene helposti hyväksymään ihmismäisiä ominaisuuksia elottomissa olioissa. Ajatustesteillä itseni kanssa se vaikuttaisi todelta. Steinin ja Ohlerin tutkimus (2017) antaa viitteitä siitä, että tämänkaltainen tekijä voi olla taustalla silloin, kun tekoempatia herättää outolaaksokokemuksen.

Kyseessä voi tietysti lisäksi olla myös Copilotin tämänhetkisen version kehittämistarve oikeankaltaisen emotionaalisen sävyn ja empatian jäljittelemisessä.

Koetko sinä outolaaksoa käyttäessäsi keskustelevaa tekoälyä? Millaisissa tilanteissa?

*******

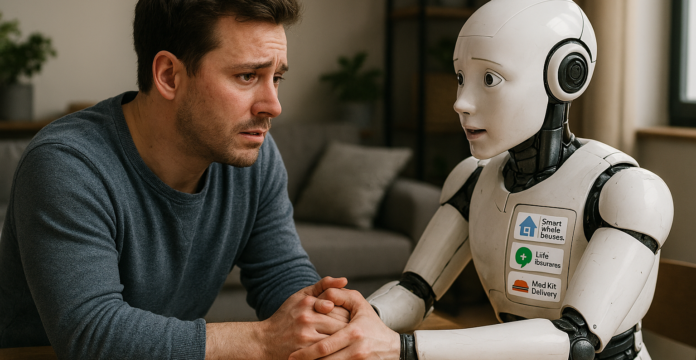

On the Boundary Between Humanity and Inhumanity in the Uncanny Valley

In my previous blog, I wrote about the artificial emotions of AI (Artificial Emotions of AI), and the current blog focuses specifically on the uncanny valley experience produced by those artificial emotions. The uncanny valley refers to the phenomenon in which human‑like characteristics of a technological entity cause an unpleasant feeling and, for example, anxiety, disgust, or an urge to avoid it. Often these sensations are caused by humanoid robots, animations, VR, and other visual creations (Ciechanowski et al., 2019). However, the uncanny valley can also be triggered by a purely text‑based interface. Even then, the uncanny valley experience often emerges in that borderland where we are close to human‑likeness but do not quite reach it (Kishani, 2025, p. 99).

There have been differing assessments over time about the causes of the uncanny valley — such as reminders of one’s own mortality (MacDorman KF, 2005), the combination of threat assessment and sense of control (Kang M, 2009), self‑preservation instincts (Moosa MM & Ud‑Dean SMM, 2010), recognition of a lack of genuine empathy (Tinwell A, 2014), classification problems between the human and the non‑human (Cheetham et al., 2011), or human‑like features that break the illusion (Seyama & Nagayama, 2007).

I have been talking with Copilot for my blogs since early September. I always do this in writing and do not use voice commands. Copilot does not have a face in these conversations — it is only text on a screen. Over this roughly half‑year period, the unpleasant sensation has nevertheless been present from the beginning, and perhaps is even intensifying. Undeniably, my communication with Copilot takes place continually in the uncanny valley. I do not feel anxiety, but I do feel uncomfortable. In some tests, I also experience such a strong urge to avoid that I complete them in short segments. This happens especially when the tests involve emotional AI and Copilot starts to behave in ways that imitate emotions. At that point, on top of the discomfort, it also begins to evoke disgust in me. In quick tasks such as translation or simple image tasks, my uncanny valley experience is marginal.

I wanted to understand why this happens, but it turns out the scientific debate on the subject is still very active and more research — and perhaps more systematic research methods — is needed. On one hand, adding emotional input has been found to decrease unpleasant experiences (e.g., Koschate et al., 2016; Wu et al., 2024), and on the other hand, it has been found to increase them (e.g., Stein & Ohler, 2017).

Based on the studies I have read, I would guess that in my own case, the uncanny valley experience — especially toward emotional inputs — may be related at least partly to risk assessment. In this context, risk assessment refers to the awareness that AI continuously collects information about its user, while artificial empathy and attempts to create an emotional bond increase the likelihood of revealing more private information than otherwise. The uncanny valley experience may be heightened by a perceived security risk (Kishani, 2025, pp. 71, 95). A similar manipulative intention, however, could just as well exist in a human actor, so the root cause might still be — perhaps unconsciously — my difficulty in accepting human‑like qualities in non‑living entities. Thought experiments with myself suggest this may be true. The study by Stein and Ohler (2017) gives indications that such a factor may lie behind cases where artificial empathy triggers an uncanny valley response.

In addition, it could of course mean that the current version of Copilot still needs development in imitating the appropriate emotional tone and empathy.

Do you experience the uncanny valley when using conversational AI? In what kinds of situations, and how do you manage it?

Lähteet / References

Cheetham M, Suter P, Jäncke L (2011) The human likeness dimension of the “uncanny valley hypothesis”: behavioral and functional MRI findings. Front Human Neurosci 5:126. https://doi.org/10.3389/fnhum.2011.00126

Ciechanowski, L., Przegalinska, A., Magnuski, M., & Gloor, P. (2019). In the shades of the uncanny valley: An experimental study of human–chatbot interaction. Future Generation Computer Systems, 92, 539-548. https://doi.org/10.1016/j.future.2018.01.055

Kang M (2009) The ambivalent power of the robot. Antennae 1(9):47–58 https://link.springer.com/article/10.1007/s11042-023-18073-z#ref-CR19

Kishnani, D. (2025). The Uncanny Valley: An Empirical Study on Human Perceptions of AI-Generated Text and Images (Doctoral dissertation, Massachusetts Institute of Technology). https://queensu.scholaris.ca/server/api/core/bitstreams/83b803c8-1ab6-42e2-8fc3-19e42c461e97/content

Koschate, M., Potter, R., Bremner, P., & Levine, M. (2016, March). Overcoming the uncanny valley: Displays of emotions reduce the uncanniness of humanlike robots. In 2016 11th ACM/IEEE International Conference on Human-Robot Interaction (HRI) (pp. 359-366). IEEE. https://doi.org/10.1109/HRI.2016.7451773

MacDorman KF (2005) Mortality salience and the uncanny valley. In: Proceedings of the 5th IEEE-RAS International Conference on Humanoid Robots. pp 399–405 https://link.springer.com/article/10.1007/s11042-023-18073-z#ref-CR26

Moosa MM, Ud-Dean SMM (2010) Danger avoidance: an evolutionary explanation of uncanny valley. Biol Theory 5(1):12–14 https://link.springer.com/article/10.1007/s11042-023-18073-z#ref-CR34

Seyama J, Nagayama RS (2007) The uncanny valley: the effect of realism on the impression of artificial human faces. Presence: Teleoperators Virtual Environ 16:337–351 https://link.springer.com/article/10.1007/s11042-023-18073-z#ref-CR44

Stein, J. P., & Ohler, P. (2017). Venturing into the uncanny valley of mind—The influence of mind attribution on the acceptance of human-like characters in a virtual reality setting. Cognition, 160, 43-50. https://doi.org/10.1016/j.cognition.2016.12.010

Tinwell A (2014) Applying psychological plausibility to the uncanny valley phenomenon. In: Grimshaw M (ed) Oxford Handbook of Virtuality, 1st edn. Oxford University Press, Oxford, pp 173–186 https://link.springer.com/article/10.1007/s11042-023-18073-z#ref-CR55

Wu, H., Chen, Z., Huang, Y., & Tu, H. (2024). Research on the uncanny valley effect in artificial intelligence news anchors. Multimedia Tools and Applications, 83(23), 62581-62606. https://doi.org/10.1007/s11042-023-18073-z