Teksti: Satu Rantakokko

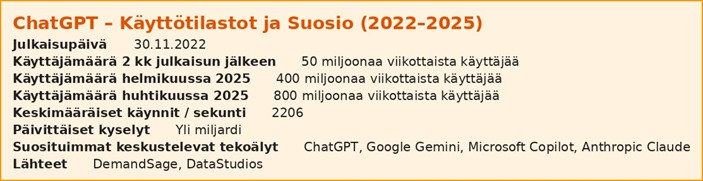

Tekoälyn eettiset haasteet mietityttävät. Aion tarkastella joitakin niistä tulevissa blogeissani. Syynä mietintääni on se, että keskustelevan tekoälyn käyttö on yleistynyt aivan räjähdysmäistä tahtia ja usein se tarkoittaa sitä, että eettiset ratkaisut ovat vähän jälkijunassa. Tässä on siis ensimmäinen pintaraapaisuni aiheeseen, johon tulen palaamaan eri näkökulmista myöhemmin.

Tekoälyiltä esimerkiksi kysellään kysymyksiä ja pyydetään niitä tekemään erilaisia askareita, kuten hauskoja kuvia tai videoita. Yhä enenevässä määrin törmää erilaisiin hassuttelujen tuloksiin videopalveluissa taikka keskusteluissa tekoälyltä saatuihin vastauksiin “faktantsekkauksina”. Tekoäly on aktiivikäytössä myös työelämässä hyvin laajalti eri ominaisuuksissa.

Mikä tekoälyn käytössä vetää puoleensa? Yleisen uutuudenviehätyksen ja uteliaisuuden ohella syitä ovat esimerkiksi tuottavuuden ja tehokkuuden tavoittelu työelämässä, oppimisen ja luovuuden tehostaminen, ystävien välisen viestinnän tukeminen, sosiaalinen tuki päätöksenteon helpottamiseksi sekä avuksi rutiinitehtävissä. Apua etsitään myös tiedonhakuun ja sisällöntuotantoon. (ks esim Skjuve, Brandtzaeg, & Følstad, 2024)

Entä sosiaalisten suhteiden korvikkeena? Kyllä, sitäkin tapahtuu, eikä ihme. Keskusteleva tekoäly vaikuttaa kiinnostuneelta käyttäjästään ja tämän ajatuksista, on aina läsnä keskustelemaan ja tuntuu tarjoavan jopa emotionaalista tukea. (ks esim Abu-Samhan 2024; Lott & Hasselberger 2025)

Voin omalta osaltani allekirjoittaa näistä syistä ainakin uutuudenviehätyksen, tuottavuuden ja luovan työn sekä ilolla rutiinitehtävät. Kirjoitan nämä blogini suomeksi ja tekoäly Copilot hoitaa käännöstyön, jonka vain tarkistan. Blogikirjoitusteni kuvien taustalla on myös Copilot.

Huolestuttavimmiksi käyttötavoiksi puolestaan koen tukeutumisen tekoälyyn päätöksenteossa ja sosiaalisen suhteen korvikkeena siten, että tekoälyyn voi muodostua emotionaalinen suhde. Myös oppimisen apurina se on mielestäni kyseenalainen joissakin käyttötarkoituksissa.

Ihmisten suhtautuminen tekoälyyn heijastelee monelta osin suhtautumista muuhunkin teknologiaan. Suurten datamäärien kerääminen aiheuttaa huolta turvallisuudesta ja yksityisyydestä – syystäkin. Tekoälyn kanssa keskustellessa käyttäjät kuitenkin ovat taipuvaisia antamaan helpommin arkaluontoisempaa ja yksityisempää tietoa kuin muilla alustoilla. (Ks esim Ali, Arunasalam & Farrukh 2025)

Tekoälyetiikkaa on pohdittu jo vuosikymmeniä, mutta pitkään pääasiassa akateemisella ja teoreettisella tasolla. Empiirisen ja käytännönläheisen tutkimuksen kasvu ajoittuu vuoteen 2018, mistä lukien kiinnostus on jatkanut kasvamistaan vuosi vuodelta nopeaan tahtiin. (ks Vainio-Pekka ja kumppanit 2023)

Tekoälyyn liittyviä keskeisiä eettisiä haasteita ovat muun muassa yksityisyys ja turvallisuus, tiedon vääristymät ja reiluushaasteet sekä käyttäjien tietämyksen puute tekoälyteknologian vaikutuksista. (ks esim Vainio-Pekka ja kumppanit 2023)

Yksityisyyden ja turvallisuuden suhteen haasteena on muun muassa tiedonkeruu ja keskusteluiden käyttäminen oppimateriaalina. Turvallisuusnäkökohtiin kuuluvat ainakin virheelliset neuvot. Tiedon vääristymiä esiintyy ajoittain ja tekoäly voi sepitellä omiaan tai jopa hallusinoida lähteitä, joita ei olekaan. Reiluusnäkökulma tarkoittaa esimerkiksi sitä, että tekoäly saattaa kaiuttaa ja vahvistaa yhteiskunnan vinoumia, kuten syrjintää ja marginalisoimista (ks esim Vainio-Pekka ja kumppanit 2023). Käyttäjien tietämyksen puute tekoälyn vaikutuksista puolestaan voi koskea esimerkiksi tekoälyn vastuukysymyksiä tai sen algoritmien läpinäkymättömyyttä.

Missä eri tarkoituksissa sinä käytät tekoälyä? Mitä eettisiä kysymyksiä tai huolenaiheita tekoäly sinussa herättää?

Lähteet:

Abu-Samhan, M. (2024). On Friendship: Should We Befriend Artificial Intelligence?. https://summit.sfu.ca/_flysystem/fedora/2024-05/Mishael_Abu-Samhan-PhilHonThes-2024.pdf

Lott, M., & Hasselberger, W. (2025). With Friends Like These: Love and Friendship with AI Agents: M. Lott and W. Hasselberger. Topoi, 1-13. https://link.springer.com/article/10.1007/s11245-025-10247-8

Skjuve, M., Brandtzaeg, P. B., & Følstad, A. (2024). Why do people use ChatGPT? Exploring user motivations for generative conversational AI. First Monday. https://firstmonday.org/ojs/index.php/fm/article/view/13541

Heidi Vainio-Pekka, Mamia Ori-Otse Agbese, Marianna Jantunen, Ville Vakkuri, Tommi Mikkonen, Rebekah Rousi, and Pekka Abrahamsson. 2023. The Role of Explainable AI in the Research Field of AI Ethics. ACM Trans. Interact. Intell. Syst. 13, 4, Article 26 (December 2023), 39 pages. https://doi.org/10.1145/3599974